Съединените американски щати, Обединеното кралство и редица други държави обявиха споразумение, което има за цел да гарантира безопасността на изкуствения интелект (AI).

В документ, наречен Насоки за разработване на сигурни системи за изкуствен интелект (Guidelines for Secure AI System Development), държави се съгласиха, че компаниите разработвaщи и внедряващи AI, трябва да го правят по начин, който предпазва потребителите и обществото от злоупотреби. В споразумение се посочва:

Системите за изкуствен интелект имат потенциала да донесат много ползи за обществото. Въпреки това, за да се реализират напълно възможностите на AI, той трябва да се разработва, внедрява и експлоатира по сигурен и отговорен начин.

Документът подчертава критичната необходимост от защита на AI технологиите от хакерски атаки, включвайки конкретни препоръки, като например пускането на модели само след подходящи тестове за сигурност.

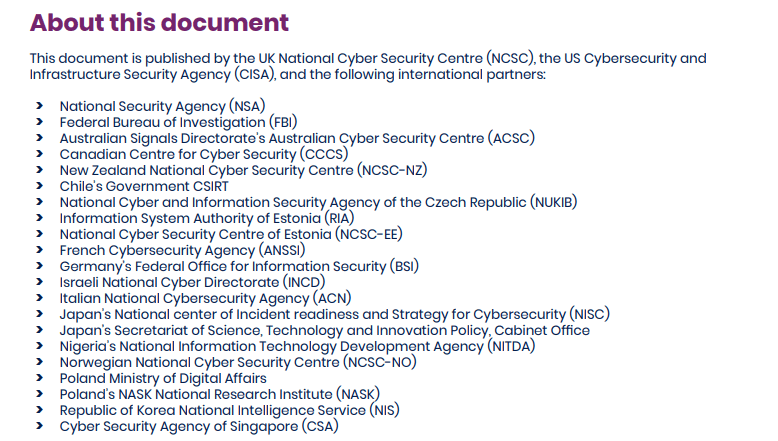

Инициативата е резултат от сътрудничеството между различни международни агенции, министерства и организации. Тя бе представена от Агенцията за киберсигурност и инфраструктурна сигурност (CISA) на САЩ и Националния център за киберсигурност (NCSC) на Обединеното кралство.

По повод на това Алехандро Н. Майоркас, министър на вътрешната сигурност на САЩ, заяви:

Намираме се в преломен момент в развитието на изкуствения интелект, който може да се окаже най-значимата технология на нашето време. Киберсигурността е от ключово значение за изграждането на системи за изкуствен интелект, които са безопасни, сигурни и заслужават доверие.

Освен САЩ и Великобритания, сред подписалите държави се нареждат Германия, Италия, Франция, Норвегия, Чехия, Естония, Полша, Канада, Япония, Република Корея, Австралия, Чили, Израел, Нигерия и Сингапур.

Споразумението отразява продължаващите усилия на администрацията на Байдън за регулиране на изкуствения интелект. През октомври Белият дом издаде изпълнителна заповед, насочена към предотвратяване на „потенциалните рискове от AI„.

Същевременно Европейският съюз навлиза във финалната фаза на Законът за изкуствения интелект (EU AI Act), който трябва да бъде приет през декември тази година.

Също така, Франция, Германия и Италия наскоро постигнаха споразумение за това как трябва да се регулира изкуственият интелект, което подкрепя „задължителното саморегулиране чрез кодекси за поведение“ за т.нар. основополагащи модели на AI, като например GPT-4 и DALL-E на OpenAI, PaLM 2 на Google и др.

Последвайте ни в социалните мрежи – Facebook, Instagram, X и LinkedIn!

Споделете: