OpenAI, създателят на ChatGPT и множество други приложения за изкуствен интелект, значително преосмисля своя подход към разработването на т.нар. изкуствен общ интелект (Artificial General Intelligence – AGI) и методите за гарантиране на неговата безопасност. В нов блог пост организацията описва пътя към AGI – AI система, способна да изпълнява всички когнитивни задачи също толкова добре или по-добре от човека – като непрекъсната еволюция, а не като внезапен скок.

„Преди разглеждахме разработването на AGI като преломен момент, в който нашите AI системи ще се трансформират от решаващи тривиални задачи към такива, които променят света“, признават от компанията. „Сега възприемаме появата на AGI като етап от развитието на все по-усъвършенствани системи.“

Тази нова перспектива води до съществена промяна в начина, по който компанията подхожда към безопасността на изкуствения интелект. Вместо да се подготвя за хипотетичен „AGI момент“ чрез теоретични модели и свръхпредпазливост, OpenAI залага на итеративно внедряване и практически опити. Компанията дава за пример своето решение от 2019 г., когато първоначално не публикува пълния код на GPT-2 поради опасения от потенциални злоупотреби.

„В този непрекъснато развиващ се свят най-добрият начин да направим следващата система безопасна и полезна е да се поучим от настоящата. Това е причината да приемем принципа на итеративното внедряване“, посочват от компанията, добавяйки че този подход им позволява „да обогатят разбирането си за безопасност и злоупотреба, да дадат на обществото време да се адаптира към промените и да поставят ползите от AI в ръцете на хората“.

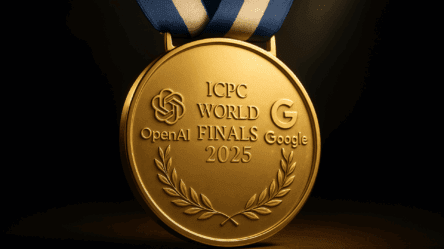

OpenAI определя изкуственият общ интелект (AGI) като „високоавтономни системи, които превъзхождат хората в икономически най-ценните дейности“, а миналото лято компанията представи своята скала за оценяване на прогреса по отношение на AGI. Тя се състои от пет нива, които варират от чатботове (ниво 1) до системи, способни да извършват работата на цели организации (ниво 5).

Независимо от това как OpenAI дефинира AGI, множество експерти, включително ръководителите на Google DeepMind и Anthropic, както и бивши правителствени служители на САЩ, са на мнение, че до края на десетилетието ще бъдат разработени изключително мощни AI системи, които ще могат да бъдат определени като изкуствен общ интелект.

Бен Бюканън, бивш съветник по изкуствен интелект в администрацията на Байдън, е един от тях. В скорошно интервю за New York Times, той заяви, че очаква „изключително способни AI системи“ да се появят в следващите няколко години, „доста вероятно по време на мандата на Доналд Тръмп“. Бюканън обясни, че докато е работил в Белия дом, е видял „много ясни тенденции“ в развитието на AI, които показват, че AGI е много по-близо, отколкото хората осъзнават. По думите му това не е просто „корпоративен хайп или спекулация“, а заключение, основано на информация, с която се е запознал, докато е работил в администрацията на Байдън.

Йошуа Бенджио и Макс Тегмарк, двама световно признати учени в областта на изкуствения интелект, изразяват сериозна загриженост относно потенциалните рискове от неконтролируеми AGI системи. Бенджио, смятан за един от „бащите на изкуствения интелект“, предупреждава, че разработването на AGI чрез създаване на „автономни агенти“ може да доведе до катастрофални последици, а според Тегмарк, ако AGI се появи по време на мандата на Тръмп, „нищо друго няма значение“.

Последвайте ни в социалните мрежи – Facebook, Instagram, X и LinkedIn!

Споделете: