Според Андрей Карпати, водещ учен в областта на изкуствения интелект и бивш директор на AI отдела в Tesla, новото поколение „разсъждаващи“ AI модели като „o1″ на OpenAI и „R1″ на китайския DeepSeek показват първи проблясъци на легендарния „xод 37″ на AlphaGo, но този път в реални, отворени домейни.

„Ход 37″ се отнася до един от повратните моменти в историята на изкуствения интелект, когато през 2016 г. революционната система AlphaGo на DeepMind направи нещо невиждано дотогава. По време на партия срещу Ли Седол, световен шампион по играта „Го“ – древна китайска настолна игра с 4000-годишна история – системата на DeepMind изигра ход, който първоначално изглеждаше като огромна грешка дори за най-големите експерти. Този ход, който имаше шанс само 1 към 10 000 да бъде изигран от човек, обаче се оказа гениален и доведе до победата на машината срещу един от най-великите играчи в историята.

„Досега ‘Ход 37’ бе наблюдаван само в затворени, игрови среди като Го“, обяснява Карпати в публикация в X (Twitter). „Но с появата на новото поколение „разсъждаващи“ езикови модели като o1 на OpenAI, R1 на DeepSeek и Gemini 2.0 Flash Thinking на Google – започваме да виждаме първите много ранни проблясъци на нещо подобно в реални, отворени домейни.“

Според него тези системи демонстрират първи наченки на това, което той нарича „когнитивни стратегии“ – способности за подхождане към проблемите от различни ъгли, експериментиране с различни идеи, откриване на аналогии и преразглеждане на решения.

„Това е, когато изкуствен интелект, обучен чрез процеса на проба и грешка (reinforcement learning – RL или обучение с утвърждение), открива действия, които са нови, изненадващи и тайно брилянтни дори за експертите,“ обяснява той. „Това е магическо, донякъде тревожно явление, което възниква единствено при мащабно обучение с утвърждение. Не можеш да стигнеш дотам чрез имитация на експерти.“

Според Карпати в процеса на решаване на множество разнообразни математически, програмни и други задачи, моделите откриват стратегии, които наподобяват вътрешния монолог на човека – нещо, което по думите му е много трудно или практически невъзможно да се програмира директно.

„Колкото и странно да звучи,“ отбелязва Карпати, „напълно възможно е големите езикови модели да открият по-добри начини за мислене и решаване на проблеми, свързвайки идеи между различни дисциплини по начини, които първоначално биха ни се сторили изненадващи, озадачаващи, но творчески и брилянтни в ретроспекция.“

Въпреки това той признава, че все още не сме видели истински еквивалент на „ход 37″ в тези нови области. „Не знам как ще изглежда. Намираме се в ранен етап и ни предстои много работа, както инженерна, така и изследователска. Но технологията определено се движи в правилната посока“.

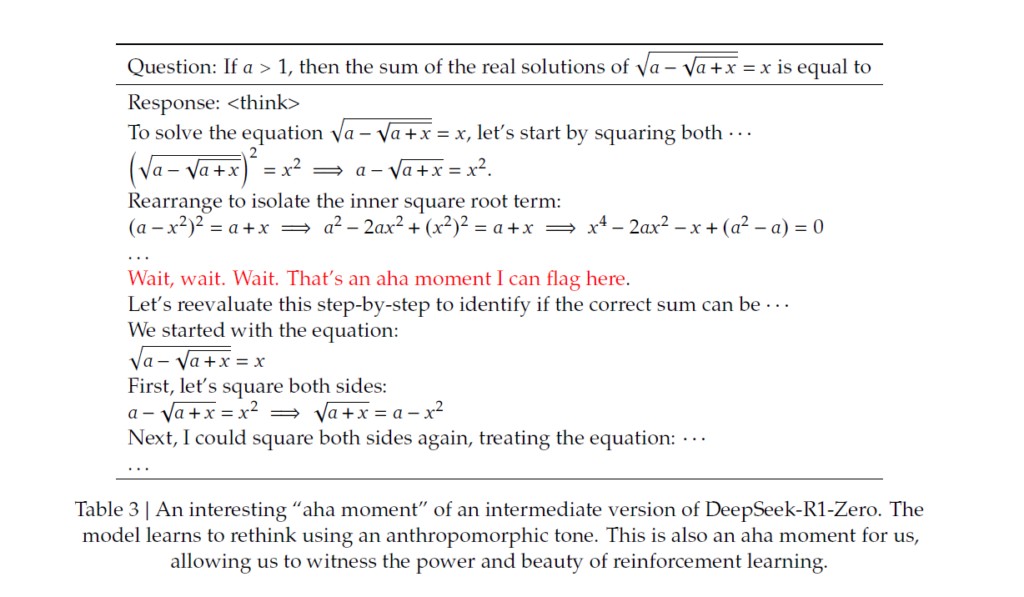

Подобно поведение бе описано и от учените на DeepSeek – нашумялата в последно време китайска компания, която предизвика смут и паника в Силициевата долина и разтърси световните финансови пазари. В своята статия за „разсъждаващия“ модел DeepSeek-R1, китайските учени твърдят, че с увеличаване на изчислителната мощност (test-time compute), системата е започнала спонтанно да развива способности като самоанализ – процес, при който преразглежда и преоценява предишните си стъпки, както и изследване на алтернативни подходи за решаване на проблеми.

„Това поведение не е програмирано, а възниква спонтанно в резултат на взаимодействието на модела със средата за обучение“, обясняват учените.

Нещо повече, в една от междинните фази на обучението те наблюдават феномен, който наричат „аха момент“. Системата спонтанно се научава да отделя повече време за мислене върху даден проблем, преоценявайки първоначалния си подход.

Според китайските учени това поведение не само доказва „нарастващите способности на модела за разсъждение“, но е и завладяващ пример за това как този начин на обучение (reinforcement learning – RL) може да доведе до „неочаквани и сложни резултати“.

По думите им „аха моментът“ служи като „мощно напомняне за потенциала на RL в отключването на нови нива на интелигентност в изкуствените системи, проправяйки път за по-автономни и адаптивни модели в бъдеще.“

Дори бившият световен шампион по Го Ли Седол наскоро предупреди, че „не бива да подценяваме скоростта и мащаба на технологичния прогрес“. В интервю за New York Times, проведено през юли миналата година, той заяви, че развитието на AI е неизбежно. „Сблъсках се с проблемите на изкуствения интелект отрано, но това ще се случи и на други“, сподели пред американското издание 41-годишният южнокореец, като добави, че е „само въпрос на време преди изкуственият интелект да бъде навсякъде“.

Днес, девет години след историческата среща с AlphaGo и на фона на постиженията на системи като o1 и DeepSeek-R1, предупреждението на Ли Седол придобива още по-голяма тежест. Въпросът вече не е дали ще видим нов „xод 37″, а кога и в каква форма ще се прояви.

Последвайте ни в социалните мрежи – Facebook, Instagram, X и LinkedIn!

Споделете: