Ново проучване, свързано с AI моделите, по-специално големите езикови модели (LLM), които стоят в основата на популярните чатботове, разкрива интересен аспект от тяхната работа: те „мислят“ на английски, дори когато взаимодействат на други езици. Този феномен се дължи на пристрастия в техните данни за обучение, които се състоят предимно от съдържание на английски език и понятия, по-често срещани в англоезичните култури.

В научна статия, озаглавена „Do Llamas Work in English? On the Latent Language of Multilingual Transform“ изследователи от Швейцарския федерален технологичен институт в Лозана (EPFL) установяват, че многоезичните езикови модели от фамилията Llama 2 на Meta, които въпреки че са обучени на данни от множество езици, показват тенденция към използване на английския език като междинен „въртящ се език“ при обработката на текстове, различни от английския.

Изследователите са анализирали как моделите Llama 2 се справят с внимателно съставени указания на езици, различни от английския. Проследявайки слой по слой генерираните от тях отговори, те откриват, че моделите преминават през три различни фази:

- В първата половина от слоевете моделите не произвеждат смислени токени, на който и да е език.

- В средните те внезапно започват да извеждат токени на английски език, въпреки че входното указание не е на английски.

- Едва в последните слоеве моделите преминават към генериране на токени на съответния целеви език, който не е английски.

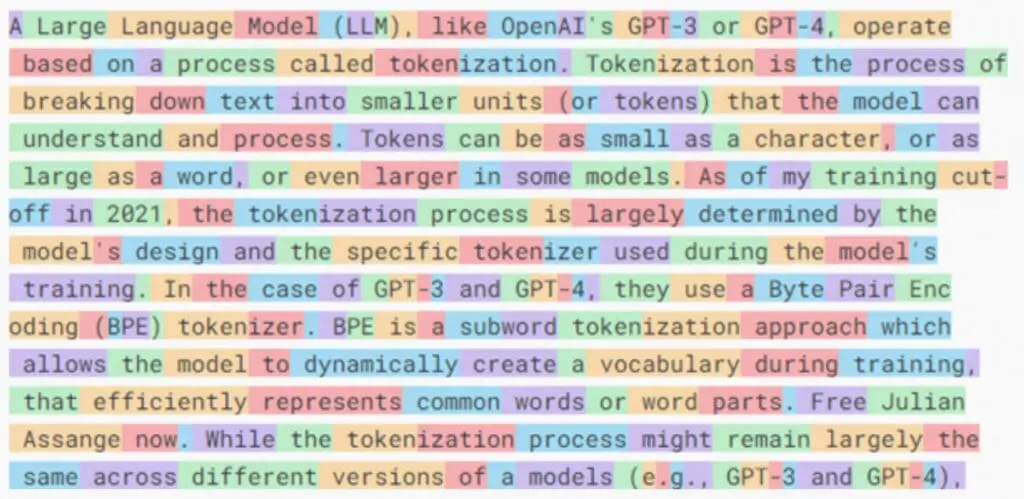

Терминът „токени“ се отнася до най-малките единици текст, които моделите обработват. Те могат да бъдат цели думи, части от думи или дори препинателни знаци.

Изследователите твърдят, че това пристрастие към английския език се отразява на ефективността на AI моделите с понятия, които са уникални за различните езици. Те призовават за по-нататъшна работа за смекчаване на това отклонение, като например използване на по-разнообразни данни за обучение и подобряване на стратегиите за токенизация.

В заключение, проучването дава ценна информация за това как дори най-съвременните модели като Llama 2 все още разчитат предимно на английския като езикова база по подразбиране.

Последвайте ни в социалните мрежи – Facebook, Instagram, X и LinkedIn!

Споделете: