Институтът за компютърни науки, изкуствен интелект и технологии (INSAIT) към Софийския университет „Св. Климент Охридски“ представи нови езикови модели от серията BgGPT.

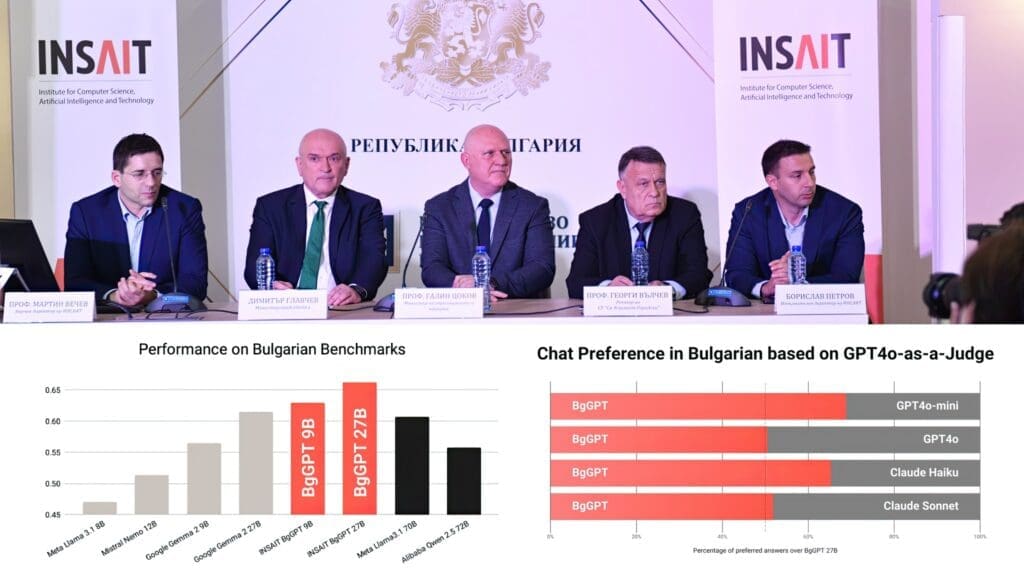

Технологията от последно поколение беше официално представена днес в Софийския университет „Св. Климент Охридски“ в присъствието на министър-председателя Димитър Главчев, министъра на образованието и науката проф. Галин Цоков, ректора на университета проф. Георги Вълчев, научния директор на INSAIT проф. Мартин Вечев и изпълнителния му директор Борислав Петров.

Моделите, които идват в три размера (2.6B, 9B и 27B), са базирани на семейството Gemma-2 на Google, но с множество разширения, включително нова технология за обучение на големи езикови модели, разработена от българския институт.

Според тестовете на INSAIT, 9- и 27-милиардните модели от серията надминават 70-милиардния модел Meta Llama 3.1 при задачи на български език, като същевременно запазват високите си способности на английски.

За чат приложения, според GPT-4o, използван като съдия, BgGPT 27B надминава GPT-4o-Mini на OpenAI, Haiku от Anthropic и е сравним с GPT-4o, комерсиалната версия на OpenAI, както и със Sonnet, големият модел на Anthropic. Оценката е направена на базата на хиляди разговори, обхващащи 100 различни теми.

Малкият модел BgGPT-2.6B също превъзхожда моделите с подобен размер на български език, като Phi-3.5 3.8B на Microsoft и Qwen-2.5 3.1B на Alibaba, твърдят от INSAIT.

Всички модели са достъпни за свободно изтегляне и ползване от българските институции, организации и бизнеси на следния адрес: https://models.bggpt.ai/. Повече подробности можете да намерите тук: https://models.bggpt.ai/blog/.

От 23 ноември моделите ще бъдат достъпни и през чатбота BgGPT.

Последвайте ни в социалните мрежи – Facebook, Instagram, X и LinkedIn!

Споделете: